DeepSeek R1 AI는 Ollama & Openwebui와 함께 마스터 로컬 LLM 기술을 사용하는 자동 스마트 스토리지 시스템입니다.

인공 지능 (AI)의 고급 경주가 진행되고 있으며 Deepseek R1 이이 분야의 리더입니다. 이 가이드는 클라우드 기반 블랙 박스에 의존하는 대신 Ollama 및 Openwebui를 사용하여 자신의 하드웨어에서 중국의 획기적인 언어 모델을 악용하는 방법을 보여줍니다. 당신이 AI 연구원이든 자기 원인 애호가이든, 지역 기업 이론적 능력을 탐색 할 준비가되어 있어야합니다.

DeepSeek R1이 AI 오픈 소스의 풍경을 형성 한 이유

중국의 개척자 Deepseek가 개발 한 Deepseek R1은 기계 이론에서 양자 도약을 나타냅니다.

– 인간과 유사한 문제 해결 : 작업을 각 단계의 프로세스로 나눕니다.

– 잠재적 AGI : OpenAI의 폐쇄 소스 모델의 라이벌 벤치 마크.

– 하드웨어 유연성 : 소비자 GPU에서 실행되는 변형.

– 투명한 설계 : 위탁 학습 협력을 개방하기위한 체중.

불투명 한 회사의 AI와 달리 DeepSeek R1의 아키텍처는 오늘날 비밀 AI 전투에서 드문 일인 감독을 초대합니다.

단계별 : DeepSeek R1을 통해 Ollama & Openwebui를 배포합니다.

DeepSeek R1 배포 전제 조건 :

– Dockerized Ollama + OpenWebuis 설치.

-NVIDIA GPU (2080 TI 또는 최신 권장).

-14B 매개 변수의 경우 16GB+ VRAM.

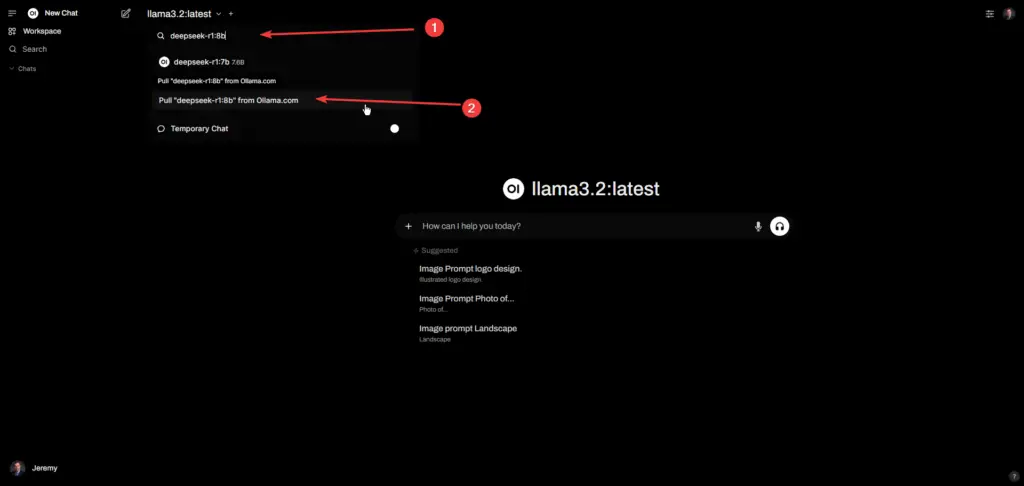

설치 작업 프로세스에는 OpenWebui 인터페이스 시작, 모델 라이브러리에서 “DeepSeek-R1″검색, 변형 선택 (7B, 14B 등)이 포함됩니다.

Deep Hardware : Deepseek을 부드럽게 실행하는 데 필요한 것

모델의 크기, 최소 GPU, VRAM 및 해당 속도에 대한 정보는 아래 표를 확인하십시오.

-7B : RTX 3060, 8GB VRAM, 90-110 알림 코드/SEC.

-8B : RTX 2080 TI, 11GB VRAM, 70-85 알림 코드/SEC.

-14B : RTX 3090, 24GB VRAM, 40-50 알림 코드/초.

모델 디코딩 모델 : 증류에서 전체 지방 R1까지

모델에서 “B”의 요소를 이해하십시오.

-7B/8B : 실시간 챗봇에 이상적입니다.

-14B : 복잡한 데이터 분석.

-R1 Original (300B+) : 연구 실험실 만.

증류는 가능성의 95%를 유지하면서 Deepseek 미니어처 모델의 독점적 인 기술입니다.

“사고”의 사고 기능 : 투명성이 중요한 이유는 무엇입니까?

DeepSeek이 “사고”알림을 표시 할 때, 그것은 정교함 일뿐 만 아니라 실제로 설명 할 수있는 사람입니다. 결정을 내리고 모델 환각을 제거하고 AI 인식에 대해 사용자에게 가르치기 위해 논리를 노출시키는 데 도움이됩니다.

고급 : Deepseek R1 Original (약한 마음이 아님)

Ollama의 증류 모델은 실제 사용을 위해 빛나는 반면, 까다로운 연구자들은 특정 요구 사항으로 전체 300b+ R1 매개 변수를 실행하려고 시도 할 수 있습니다.

이것이 미래에 왜 중요한가

AGI 개발을 세 번 가속화하기위한 DeepSeek의 개방형 웨이트 전략 :

– 학습 액세스 : 전 세계 대학은 현재 R1의 건축을 탐색하고 있습니다.

– 지역 통제 : 지정 학적 클라우드 서비스의 한계를 무시하십시오.

– 윤리 감사 : 누구나 잘못/안전 문제를 확인할 수 있습니다.

오늘 시작 : Revolution AI Storage에 가입

– 배포 : Ollama 설정 안내서를 모니터링하십시오.

– 실험 : 모델 출력 7b vs 14b 비교.

– 기여 : DeepSeek의 Github를 통해 개선 사항을 보냅니다.

최종 판결 : DeepSeek R1은 과장 되었습니까?

DeepSeek R1의 장점은 논리 퍼즐에서 LLAMA 3보다 우수한, 클래스의 AI에 대한 전례없는 투명성 및 취미 사람들에서 비즈니스 하드웨어로 확장 할 수있는 능력을 포함합니다. 이 단점에는 비 기술적 인 사용자를위한 경 사진 학습 곡선과 제한된 다국어 지원 (중국어/영어)이 포함됩니다.

대부분의 AI 혁신이 닫힌 문 뒤에서 발생하는 세계에서 DeepSeek R1은 혁신적인 예외입니다. 고급 공연으로 오픈 소스 윤리와 결혼함으로써 AI 모델 일뿐 만 아니라 민주화 된 인공 지능에 대한 선언입니다. 당신의 움직임 : Deepsek-R1 : 8B 오늘의 모델과 내일의 AI 경험을 드래그하십시오.

AI를 민주화하기위한 경쟁은 여기에 있습니다 Deepseek R1 주요 수수료. 클라우드 기반 블랙 박스에 의존하는 것을 잊어 버리십시오. 이 튜토리얼은 Ollama와 Openwebui를 사용하여 자신의 하드웨어에서 중국의 획기적인 언어 모델을 악용하는 방법을 보여줍니다. 당신이 AI 연구원이든 자기 원인 애호가이든, 지역 기업 수준의 이론적 능력을 잠금 해제 할 준비를하십시오.

DeepSeek R1이 AI 오픈 소스의 풍경을 형성 한 이유

AI Pioneer Deepsek of China에 의해 개발 된 R1 모델 (2025 년 1 월에 출판)은 추론 이론에서 양자 도약을 나타냅니다.

- 사람들처럼 문제를 해결하십시오: 작업을 각 단계의 프로세스로 나눕니다.

- 잠재적 인 Agi: OpenAI의 폐쇄 소스 모델의 라이벌 벤치 마크

- 하드웨어 유연성: 소비자 GPU의 증류 변형

- 설계 투명성: 열린 학습 협력 위탁의 체중

불투명 회사의 AI와 달리 DeepSeek R1의 아키텍처는 오늘날 비밀 AI 전투에서 드문 일인 감독을 초대합니다.

단계별 : DeepSeek R1을 통해 Ollama & Openwebui를 배포합니다.

전제 조건:

- Dockerized Ollama + OpenWebuis 설정

- GPU NVIDIA (2080 TI 또는 최신 권장)

- 매개 변수에 대한 16GB+ VRAM 14b

작업 프로세스 설정:

- OpenWebui의 인터페이스를 소개합니다

- 모델 라이브러리에서 “DeepSeek-R1″을 검색하십시오

- 변형을 선택하십시오 (7B, 14B 등)

- 딸깍 하는 소리 가위 다운로드를 시작합니다

Pro Tip: Start with the 8B model for optimal speed/accuracy balance on mid-tier GPUs.

Deep Hardware : Deepseek을 부드럽게 실행하는 데 필요한 것

| 모델 크기 | 최소 GPU | vram | 속도 (알림 코드/초) |

|---|---|---|---|

| 7b | RTX 3060 | 8GB | 90-110 |

| 8b | RTX 2080 TI | 11GB | 70-85 |

| 14b | RTX 3090 | 24GB | 40-50 |

현실 세계에서 확인하십시오: 2080 ti는 클라우드에서 API에 대비할 수있는 8B 모델에 78/두 번째 알림 코드로 오버 클럭됩니다!

모델 디코딩 모델 : 증류에서 전체 지방 R1까지

b의 요소 이해”:

- 7b/8b: 실시간 챗봇에 이상적입니다

- 14b: 복잡한 데이터 분석

- R1 원본 (300b+): 연구 실험실 지표

증류 설명:

DeepSeek의 독점 기술은 40 타임 모델을 최소화하면서 가능성의 95%를 유지합니다. 품질을 잃지 않고 압축 된 것처럼 생각하십시오.

생각의 특징”: 왜 투명성이 중요한가

DeepSeek가 표시 될 때 :

(THINKING) Analyzing user query...

(THINKING) Cross-referencing training data...그것은 미묘함 일뿐 만 아니라 이것이입니다 누가 설명 할 수 있습니다 행동 :

- 논리 노출 결정

- 모델 환각을 삭제하는 데 도움이됩니다

- AI에 대해 사용자에게 가르치십시오

고급 : Deepseek R1 Original (약한 마음이 아님)

Ollama의 증류 모델은 실제 사용을 위해 빛나는 반면, 까다로운 연구자들은 전체 매개 변수 300b+ r1을 실행하려고 시도 할 수 있습니다.

요구:

- 8x A100 GPU (각 VRAM 80GB)

- 코다의 맞춤형 최적화

- 인내 (각 응답에 대한 3-5 분)

Warning: Unsloth’s experimental workflow reduces VRAM needs by 70%, but stability isn’t guaranteed.

이것이 미래에 왜 중요한가

AGI 개발을 세 번 가속화하기위한 DeepSeek의 개방형 웨이트 전략 :

- 연구 액세스: 전 세계 대학은 현재 R1의 건축물을 탐색하고 있습니다.

- 지역 통제: 지정 학적 클라우드 서비스의 한계를 무시하십시오

- 윤리 감사: 누구나 잘못/안전 문제를 확인할 수 있습니다

오늘 시작 : Revolution AI Storage에 가입

- 전개: 우리를 따르십시오 Ollama 설정을위한 지침

- 실험: 모델 출력 7B 대 14B를 비교하십시오

- 기여하다: 개선 사항을 보내십시오 Deepseek의 Github

최종 판결 : DeepSeek R1은 과장 되었습니까?

이점:

- 논리 수수께끼의 뛰어난 라마 3

- 전례없는 투명성은 클래스를위한 것입니다

- 취미에서 비즈니스 하드웨어로 확장 할 수 있습니다

단점:

- 비 기술적 인 사용자를위한 경사 학습 곡선

- 제한된 다국어 (중국 포커스/영어) 지원

대부분의 AI 혁신이 닫힌 문 뒤에서 발생하는 세계에서 DeepSeek R1은 혁신적인 예외입니다. 고급 공연과 함께 오픈 소스 윤리와 결혼함으로써 AI 모델 일뿐 만 아니라 민주화 된 인공 지능에 대한 선언입니다.

당신의 움직임: 드래그 deepseek-r1:8b 오늘의 모델과 내일의 용어에 대한 경험.

<

div class = “임신”>

<

H1> 결론 Deepseek R1 AI : Ollama & Openwebui와 함께 지역 LLM을 배치하면 Advanced AI 민주당 경주의 문을 열고 있습니다. Ollama와 Openwebui를 사용하면 자신의 하드웨어에서 중국의 획기적인 언어 모델을 악용 할 수 있습니다. 이것은 AI 연구자들에게도 흥미로울뿐만 아니라 자기 주정부 애호가들이 지역에서 기업 수준의 이론적 능력을 발견 할 수있는 기회이기도합니다.

세부 사항 및 등록을 참조하십시오 . Awesome {위치 : 절대; 국경 : 2px Solid #990000; -Moz-Radius : 50%; -ms-border-radius : 50%; 국경-라디우스 : 50%; 애니메이션 : 바운스 2S 무한; -webkit- 애니메이션 : 바운스 2s 무한; -Moz-Animation : Bounce 2S Infinite; -o-anime : 바운스 2s 무한; 디스플레이 : 인라인 블록; 패딩 : 3px 3px 3px; 색상 : #fff; 배경 : #990000; 글꼴 크기 : 20px; 선-높이 : 1; -Moz 국경 Radius : 5px; -webkit-border-radius : 5px; -Moz-Box-Shadow : 0 1px 3px #999; -webkit-box-shadow : 0 1px 3px #999; 텍스트 -shadow : 0 -1px 1px #222; 국경-바닥 : 1px 고체 #222; 위치 : 상대; 커서 : 포인터; }

게시물 새로운 기술 발견 : Deepseek R1 AI- Ollama & Openwebui와 함께 통합 마스터 로컬 LLM 처음에 나타났습니다 퀸 모바일.